99-interview

Redis 远程数据字典服务器(REmote DIctionary Server)

1. RESP

redis通讯协议RESP- RESP协议有一些通用的规则:

- 第一个字节作为类型标识

- 使用CRLF(即

\r\n)作为分隔符, 协议的每个部分都是用这两个字节作为分隔符

| 数据类型 | 最低的支持版本 | 分类 | 第一个字节 |

|---|---|---|---|

| Simple strings | RESP2 | Simple | + |

| Simple Errors | RESP2 | Simple | - |

| Integers | RESP2 | Simple | : |

| Bulk strings | RESP2 | Aggregate | $ |

| Arrays | RESP2 | Aggregate | * |

| Nulls | RESP3 | Simple | _ |

| Booleans | RESP3 | Simple | # |

| Doubles | RESP3 | Simple | , |

| Big numbers | RESP3 | Simple | ( |

| Bulk errors | RESP3 | Aggregate | ! |

| Verbatim strings | RESP3 | Aggregate | = |

| Maps | RESP3 | Aggregate | % |

| Sets | RESP3 | Aggregate | ~ |

| Pushes | RESP3 | Aggregate | > |

2. 架构模式

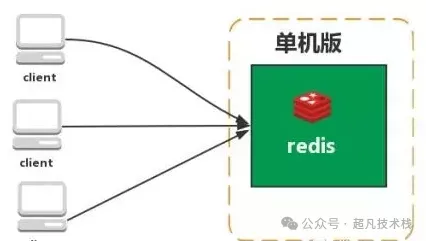

1. 单机版

- 特点:简单

- 缺点:

- 内存容量有限

- 处理能力有限

- 无法高可用

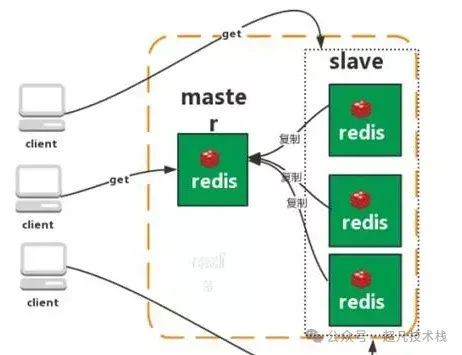

2. 主从复制

特点:

- master/slave 角色

- master/slave 数据相同

- 降低 master 读压力在转交从库

问题:

- 无法保证高可用

- 没有解决 master 写的压力

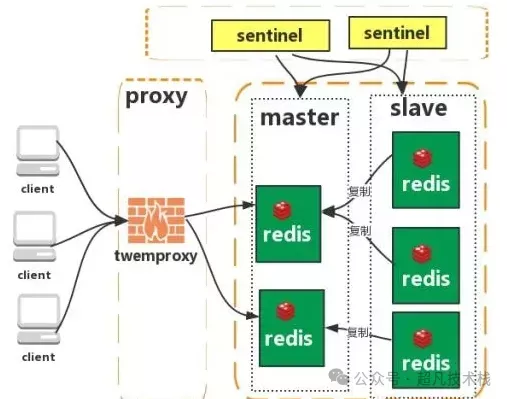

3. 哨兵

Redis sentinel 是一个分布式系统中监控 redis 主从服务器,并在主服务器下线时自动进行故障转移。其中三个特性:

- 监控(Monitoring):Sentinel 会不断地检查你的主服务器和从服务器是否运作正常

- 提醒(Notification):当被监控的某个 Redis 服务器出现问题时, Sentinel 可以通过 API 向管理员或者其他应用程序发送通知

- 自动故障迁移(Automatic failover):当一个主服务器不能正常工作时, Sentinel 会开始一次自动故障迁移操作

特点:

- 保证高可用

- 监控各个节点

- 自动故障迁移

缺点:

- 主从模式,切换需要时间丢数据

- 没有解决 master 写的压力

4. 集群(proxy型)

Twemproxy是一个Twitter开源的一个Redis和Memcache快速/轻量级代理服务器。是一个快速的单线程代理程序,支持Memcached ASCII协议和Redis协议

特点:

- 多种 hash 算法:MD5、CRC16、CRC32、CRC32a、hsieh、murmur、Jenkins

- 支持失败节点自动删除

- 后端 Sharding 分片逻辑对业务透明,业务方的读写方式和操作单个 Redis 一致

缺点:

- 增加了新的 proxy,需要维护其高可用

- failover 逻辑需要自己实现,其本身不能支持故障的自动转移。可扩展性差,进行扩缩容都需要手动干预

5. 集群(直连型)

从Redis 3.0之后版本支持Redis-Cluster集群,采用无中心结构,每个节点保存数据和整个集群状态,每个节点都和其他所有节点连接

特点:

- 无中心架构(不存在哪个节点影响性能瓶颈),少了proxy层

- 数据按照slot存储分布在多个节点,节点间数据共享,可动态调整数据分布

- 可扩展性,可线性扩展到1000个节点,节点可动态添加、删除

- 高可用性,部分节点不可用时,集群仍可用。通过增加Slave做备份数据副本

- 实现故障自动failover,节点之间通过gossip协议交换状态信息,用投票机制完成Slave到Master的角色提升

缺点:

- 资源隔离性较差,容易出现相互影响的情况

- 数据通过异步复制,不保证数据的强一致性

3. detail

Redis磁盘快照是不是原子操作?

- 是的,当服务器不在执行命令时,Redis后台保存进程总是被创建,因此每个命令在RAM中是原子的,并且在磁盘快照过程也是原子的

Redis是单线程的,怎么利用多CPU/核?

- CPU基本不可能成为的Redis的瓶颈,因为通常Redis受限于内存或网络。eg:使用Pipelining,Redis运行在普通的Linux系统上,每秒可以处理50万请求,所以如果应用程序主要使用 或 命令,几乎不会使用太多的CPU

- 然而为了最大限度利用CPU,可以在一台机器上启动多个Redis实例,并设置为不同服务器。某些时候单个机器是不够的,所以如果想使用多个CPU,可以提前考虑使用分片

- 关于使用多Redis实例,可以在Partitioning page找到更多的信息

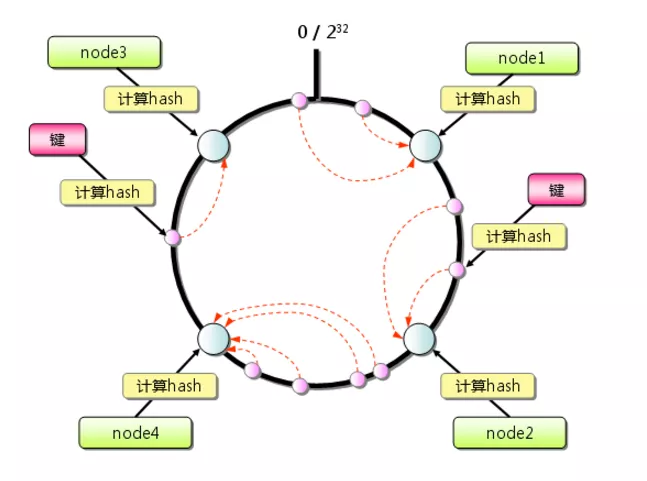

99. 一致性哈希算法

1. 背景

- 一致性哈希算法在1997年由麻省理工学院的Karger等人在解决分布式Cache中提出的,设计目标是为了解决因特网中的热点(Hot spot)问题,初衷和CARP十分类似。一致性哈希修正了CARP使用的简单哈希算法带来的问题,使得DHT可以在P2P环境中真正得到应用。

- 但现在一致性hash算法在分布式系统中也得到了广泛应用,研究过memcached缓存数据库的人都知道,memcached服务器端本身不提供分布式cache的一致性,而是由客户端来提供,具体在计算一致性hash时采用如下步骤:

- 首先求出memcached服务器(节点)的哈希值,并将其配置到0~232的圆(continuum)上。

- 然后采用同样的方法求出存储数据的键的哈希值,并映射到相同的圆上。

- 然后从数据映射到的位置开始顺时针查找,将数据保存到找到的第一个服务器上。如果超过232仍然找不到服务器,就会保存到第一台memcached服务器上。

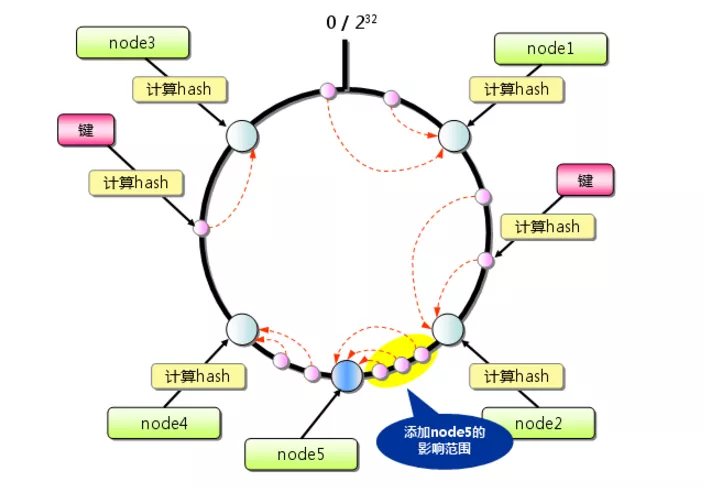

- 从上图的状态中添加一台memcached服务器。余数分布式算法由于保存键的服务器会发生巨大变化而影响缓存的命中率,但Consistent Hashing中,只有在园(continuum)上增加服务器的地点逆时针方向的第一台服务器上的键会受到影响,如下图所示:

2. 一致性Hash性质

考虑到分布式系统每个节点都有可能失效,并且新的节点很可能动态的增加进来,如何保证当系统的节点数目发生变化时仍然能够对外提供良好的服务,这是值得考虑的,尤其实在设计分布式缓存系统时,如果某台服务器失效,对于整个系统来说如果不采用合适的算法来保证一致性,那么缓存于系统中的所有数据都可能会失效(即由于系统节点数目变少,客户端在请求某一对象时需要重新计算其hash值(通常与系统中的节点数目有关),由于 hash 值已经改变,所以很可能找不到保存该对象的服务器节点),因此一致性 hash 就显得至关重要,良好的分布式 cache 系统中的一致性 hash 算法应该满足以下几个方面:

- 平衡性(Balance)

- 指哈希的结果能够尽可能分布到所有的缓冲中去,这样可以使得所有的缓冲空间都得到利用。很多哈希算法都能够满足这一条件

- 单调性(Monotonicity)

- 指如果已经有一些内容通过哈希分派到了相应的缓冲中,又有新的缓冲区加入到系统中,那么哈希的结果应能够保证原有已分配的内容可以被映射到新的缓冲区中去,而不会被映射到旧的缓冲集合中的其他缓冲区。简单的哈希算法往往不能满足单调性的要求,如最简单的线性哈希:

x = (ax + b) mod (P),在上式中,P表示全部缓冲的大小。不难看出,当缓冲大小发生变化时(从P1到P2),原来所有的哈希结果均会发生变化,从而不满足单调性的要求。哈希结果的变化意味着当缓冲空间发生变化时,所有的映射关系需要在系统内全部更新。而在P2P系统内,缓冲的变化等价于Peer加入或退出系统,这一情况在P2P系统中会频繁发生,因此会带来极大计算和传输负荷。单调性就是要求哈希算法能够应对这种情况

- 指如果已经有一些内容通过哈希分派到了相应的缓冲中,又有新的缓冲区加入到系统中,那么哈希的结果应能够保证原有已分配的内容可以被映射到新的缓冲区中去,而不会被映射到旧的缓冲集合中的其他缓冲区。简单的哈希算法往往不能满足单调性的要求,如最简单的线性哈希:

- 分散性(Spread)

- 在分布式环境中,终端有可能看不到所有的缓冲,而是只能看到其中的一部分。当终端希望通过哈希过程将内容映射到缓冲上时,由于不同终端所见的缓冲范围有可能不同,从而导致哈希的结果不一致,最终的结果是相同的内容被不同的终端映射到不同的缓冲区中。这种情况显然是应该避免的,因为它导致相同内容被存储到不同缓冲中去,降低了系统存储的效率。分散性的定义就是上述情况发生的严重程度。好的哈希算法应能够尽量避免不一致的情况发生,也就是尽量降低分散性

- 负载(Load)

- 负载问题实际上是从另一个角度看待分散性问题。既然不同的终端可能将相同的内容映射到不同的缓冲区中,那么对于一个特定的缓冲区而言,也可能被不同的用户映射为不同的内容。与分散性一样,这种情况也是应当避免的,因此好的哈希算法应能够尽量降低缓冲的负荷

- 平滑性(Smoothness)

- 平滑性是指缓存服务器的数目平滑改变和缓存对象的平滑改变是一致的

3. 原理

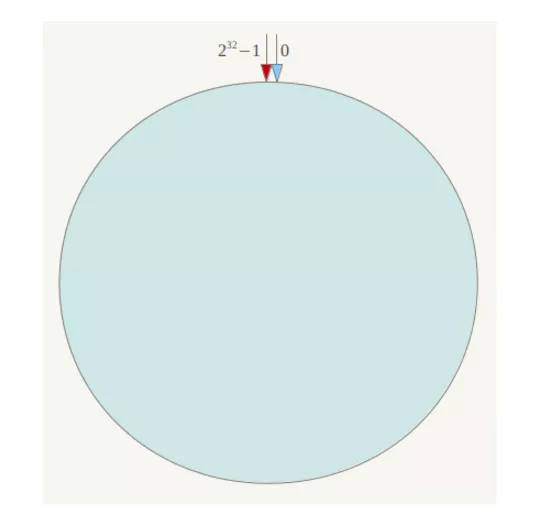

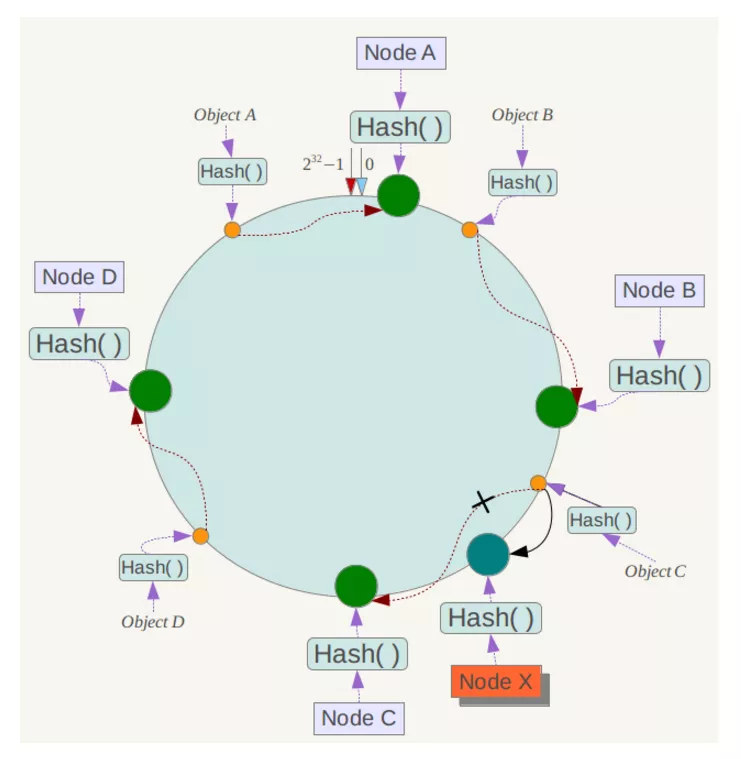

- 一致性哈希算法(Consistent Hashing)最早在论文《Consistent Hashing and Random Trees: Distributed Caching Protocols for Relieving Hot Spots on the World Wide Web》中被提出。简单来说,一致性哈希将整个哈希值空间组织成一个虚拟的圆环。eg:假设某哈希函数H的值空间为

0 ~ 2^32-1(即哈希值是一个32位无符号整型),整个哈希空间环如下:

- 整个空间按顺时针方向组织。

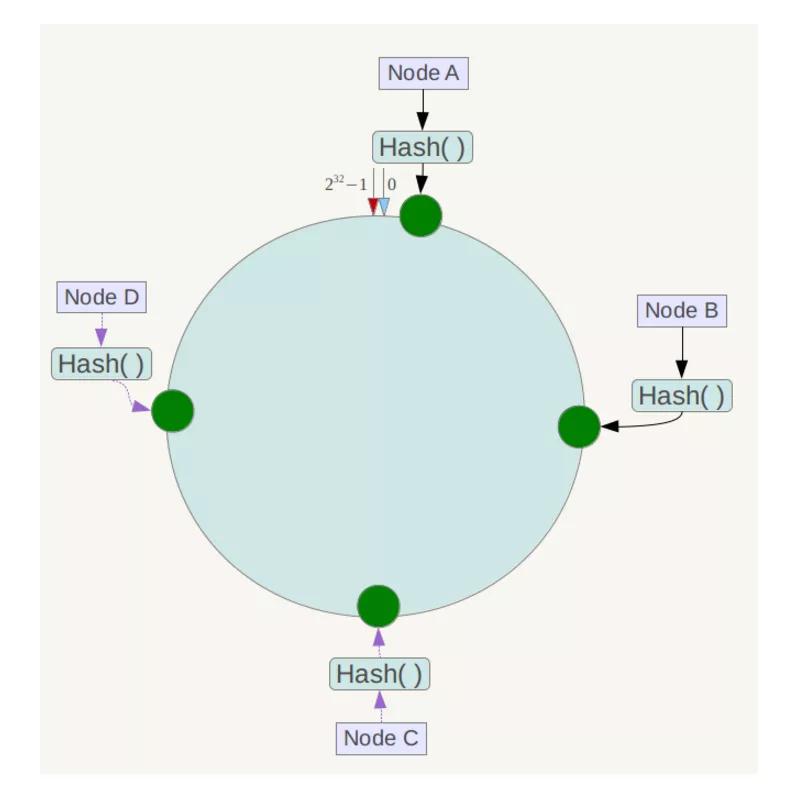

0和2^32 - 1在零点中方向重合 - 下一步将各个服务器进行哈希,具体可以选择服务器ip或主机名作为关键字进行哈希,这样每台机器就能确定其在哈希环上的位置,这里假设将上文中四台服务器使用ip地址哈希后在环空间的位置如下:

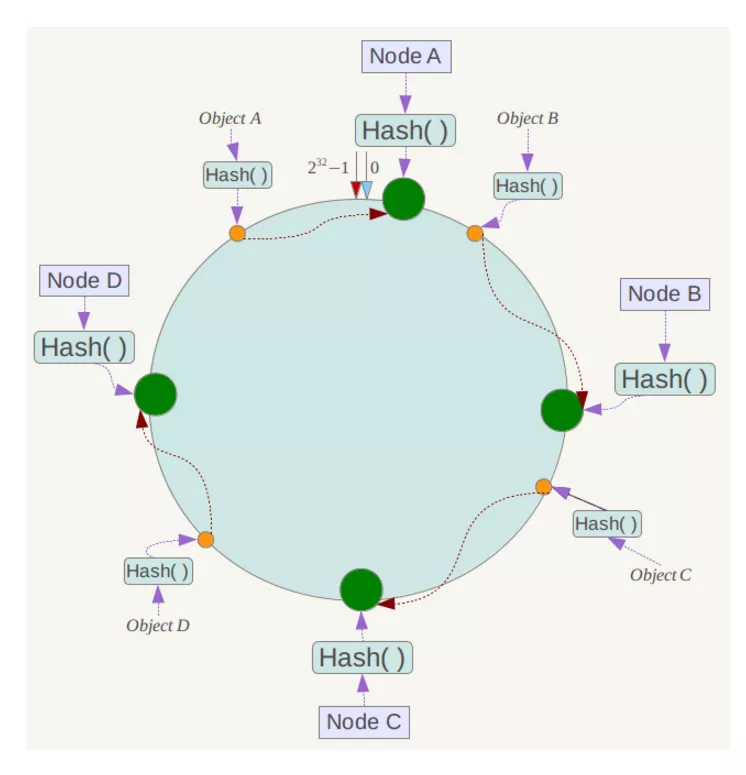

- 接下来使用如下算法定位数据访问到相应服务器:将数据key使用相同的函数Hash计算出哈希值,并确定此数据在环上的位置,从此位置沿环顺时针“行走”,第一台遇到的服务器就是其应该定位到的服务器

- eg:有ObjA、ObjB、ObjC、ObjD四个数据对象,经过哈希计算后,在环空间上的位置如下:

- 根据一致性哈希算法,数据A会被定位到NodeA上,B被定为到NodeB上,C被定为到NodeC上,D被定为到NodeD上

- 分析一致性哈希算法的容错性和可扩展性。现假设NodeC不幸宕机,可以看到此时对象A、B、D不会受到影响,只有C对象被重定位到NodeD。一般的,在一致性哈希算法中,如果一台服务器不可用,则受影响的数据仅仅是此服务器到其环空间中前一台服务器(即沿着逆时针方向行走遇到的第一台服务器)之间数据,其它不会受到影响

- 另外一种情况,如果在系统中增加一台服务器NodeX,如图:

- 此时对象Object A、B、D不受影响,只有对象C需要重定位到新的Node X 。一般的,在一致性哈希算法中,如果增加一台服务器,则受影响的数据仅仅是新服务器到其环空间中前一台服务器(即沿着逆时针方向行走遇到的第一台服务器)之间数据,其它数据也不会受到影响

- 综上所述,一致性哈希算法对于节点的增减都只需重定位环空间中的一小部分数据,具有较好的容错性和可扩展性

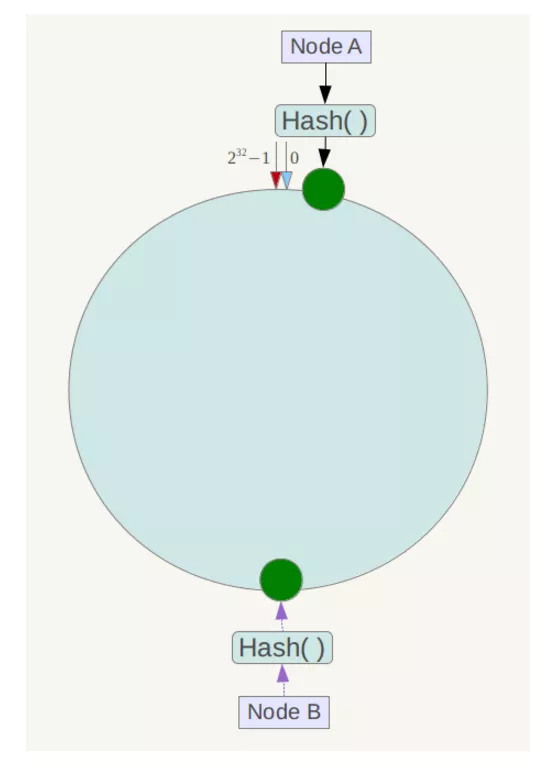

- 另外,一致性哈希算法在服务节点太少时,容易因为节点分部不均匀而造成数据倾斜问题。eg:系统中只有两台服务器,其环分布如下

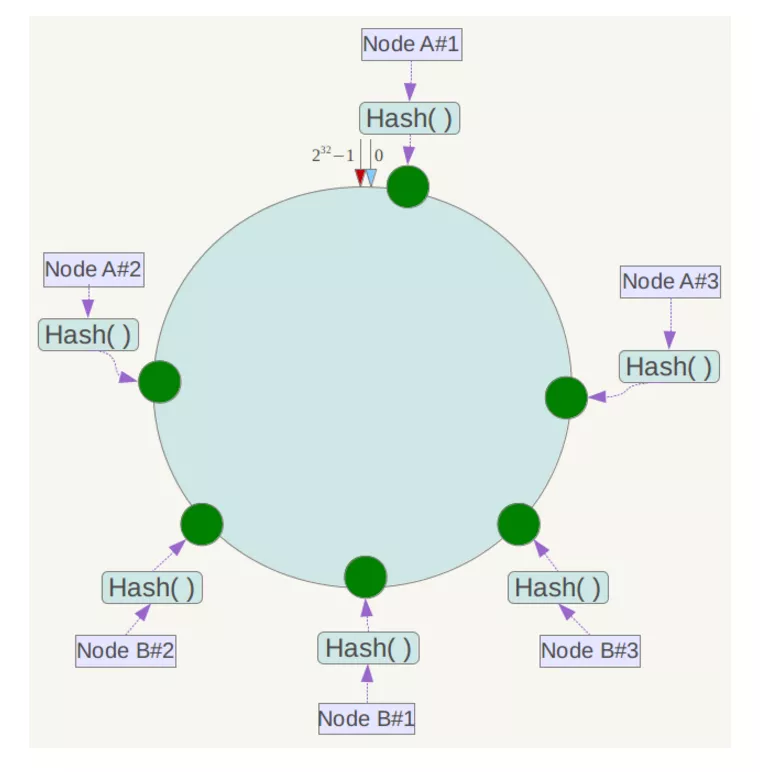

- 此时必然造成大量数据集中到NodeA上,而只有极少量会定位到NodeB上。为了解决这种数据倾斜问题,一致性哈希算法引入了虚拟节点机制,即对每一个服务节点计算多个哈希,每个计算结果位置都放置一个此服务节点,称为虚拟节点。具体做法可以在服务器ip或主机名的后面增加编号来实现

- eg:上面的情况,可以为每台服务器计算三个虚拟节点,于是可以分别计算

NodeA#1、NodeA#2、NodeA#3、NodeB#1、NodeB#2、NodeB#3的哈希值,于是形成六个虚拟节点:

- 同时数据定位算法不变,只是多了一步虚拟节点到实际节点的映射

- eg:定位到

NodeA#1、NodeA#2、NodeA#3三个虚拟节点的数据均定位到NodeA上。解决了数据倾斜问题。在实际应用中,通常将虚拟节点数设置为32甚至更大,因此即使很少的服务节点也能做到相对均匀的数据分布